关联与关联

关联和相关是解释两个统计变量之间关系的两种方法。关联指的是一个更广义的术语,关联可以看作是关联的一个特例,其中变量之间的关系本质上是线性的。

什么是联想?

统计术语关联被定义为两个随机变量之间的关系,使它们在统计上相互依赖。它指的是一种一般的关系,没有具体的关系被提及,也没有必要是一种因果关系。

许多统计方法被用来建立两个变量之间的关联。皮尔逊相关系数、优势比、距离相关、古德曼和克鲁斯卡尔的Lambda和Spearman的rho(ρ)是几个例子。

什么是相关性?

相关性是两个变量之间关系强度的度量。相关系数根据另一个变量的变化来量化一个变量的变化程度。在统计学中,相关性与相关性的概念有关,即两个变量之间的统计关系

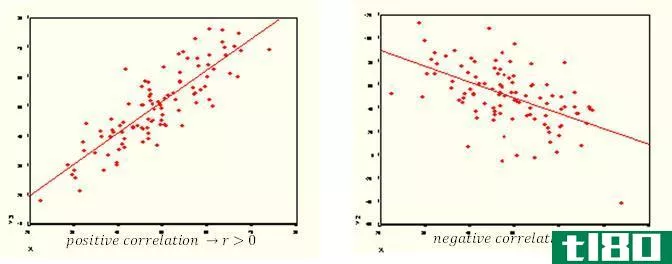

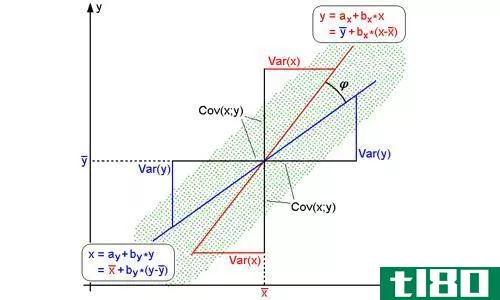

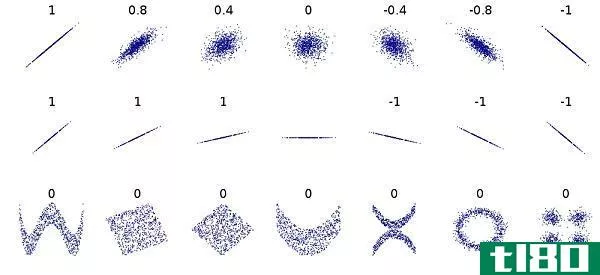

皮尔逊相关系数或仅相关系数r是-1和1之间的值(-1≤r≤+1)。它是最常用的相关系数,仅对变量之间的线性关系有效。如果r=0,则不存在关系;如果r≥0,则关系成正比;一个变量的值随另一个变量的增加而增加。如果r≤0,则关系成反比;一个变量随着另一个变量的增加而减少。

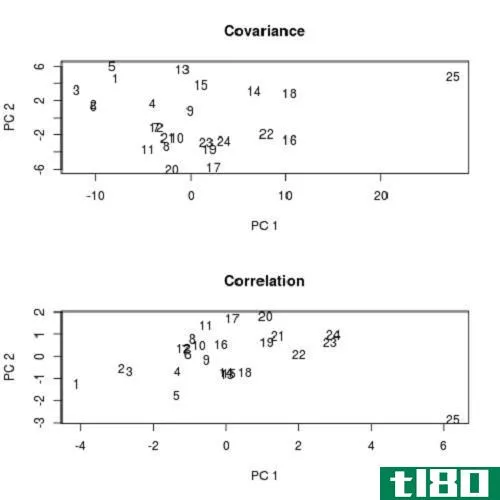

由于线性条件,相关系数r也可用于建立变量之间的线性关系。

Spearman的秩相关系数和Kendrall的秩相关系数度量关系的强度,不包括线性因素。他们考虑一个变量随另一个变量的增减程度。如果两个变量同时增加,系数将为正,如果一个变量增加而另一个变量减少,则系数值将为负。

秩相关系数只是用来确定关系的类型,而不是像Pearson的相关系数那样进行详细的研究。它们还用于减少计算,使结果更独立于所考虑的分布的非正态性。

关联和关联有什么区别?

•关联是指两个随机变量之间的一般关系,而相关性是指随机变量之间或多或少的线性关系。

•关联是一个概念,但相关性是关联的度量,并提供数学工具来度量相关性的大小。

•皮尔逊积矩相关系数确定了线性关系的存在,并确定了关系的性质(无论是成比例还是反比例)。