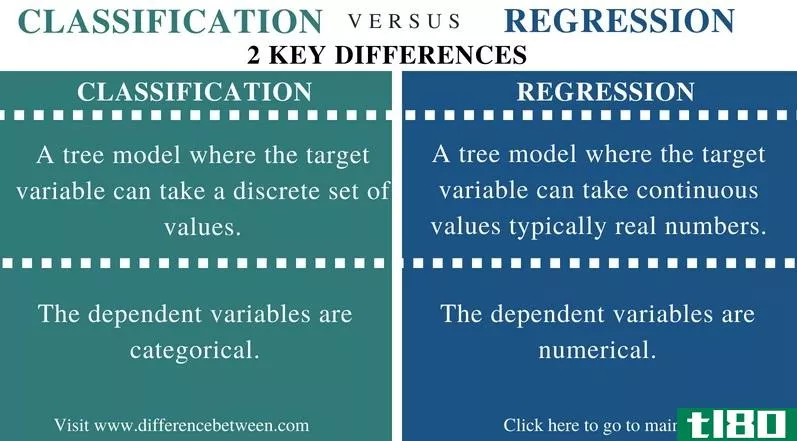

分类与回归树的主要区别在于分类时因变量是分类的和无序的,而回归中的因变量是连续的或有序的整值。

分类和回归是从收集的数据中创建预测模型的学习技术。这两种技术都以图形化的方式表示为分类树和回归树,或者更确切地说是在每一步之后对数据进行划分的流程图,或者更确切地说,是树中的“分支”。这个过程称为递归分区。像挖掘这样的领域使用这些分类和回归学习技术。本文主要研究分类树和回归树。

目录

1. 概述和主要区别

2. 什么是分类

3. 什么是回归

4. 并列比较-分类与表格形式的回归

5. 摘要

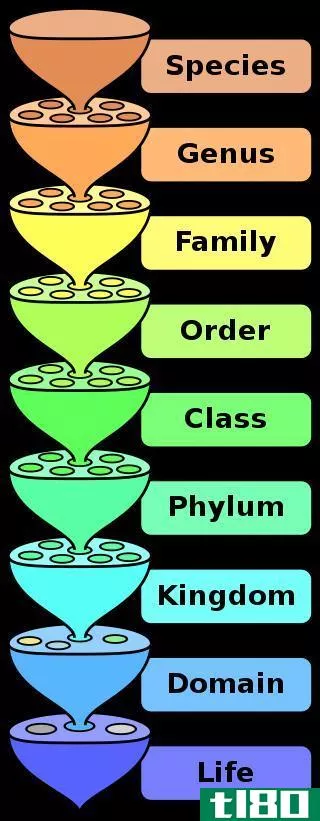

什么是分类(classification)?

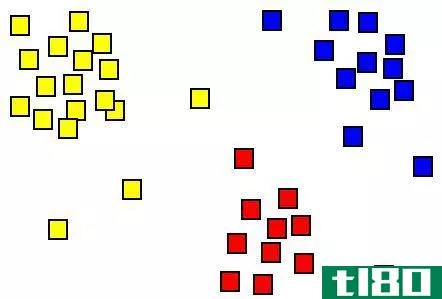

分类是一种用于获得示意图的技术,该示意图显示以前体变量开始的数据组织。因变量是对数据进行分类的变量。

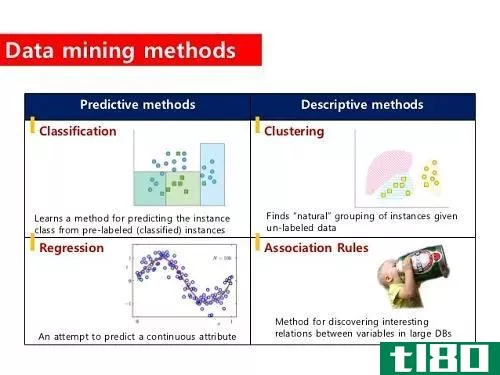

图01:数据挖掘

分类树从自变量开始,根据现有的因变量将其分为两组。它旨在阐明因变量所带来的分类反应。

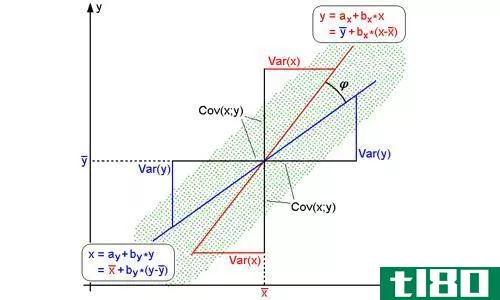

什么是回归(regression)?

回归是一种基于假定或已知的数值输出值的预测方法。这个输出值是一系列递归分区的结果,每个步骤都有一个数值和另一组因变量,这些变量会分支到另一对,比如这样。

回归树以一个或多个前驱变量开始,以一个最终输出变量结束。因变量可以是连续的或离散的数值变量。

分类(classification)和回归(regression)的区别

| 分类与回归 | |

| 目标变量可以取一组离散值的树模型。 | 一种树模型,目标变量可以取连续值,通常是实数。 |

| 因变量 | |

| 对于分类树,因变量是范畴变量。 | 对于回归树,因变量是数值的。 |

| 价值观 | |

| 具有一定数量的无序值。 | 既有离散的有序值,也有不明确的值。 |

| 建设目的 | |

| 构造回归树的目的是使一个回归系统与每一个行列式分支相适应,从而得到期望的输出值。 | 分类树的分支由从上一个节点派生的因变量决定。 |

总结 - 分类(classification) vs. 回归(regression)

回归和分类树是一种有用的技术,可以用来绘制指向研究结果的过程,无论是分类还是单个数值。分类树和回归树的区别是它们的因变量。分类树有分类和无序的因变量。回归树具有连续值或有序整值的因变量。

引用

1.“决策树学习”,维基百科,维基媒体基金会,2018年5月13日。此处提供