马斯克、霍金和乔姆斯基警告说,由人工智能推动的机器人战争即将来临

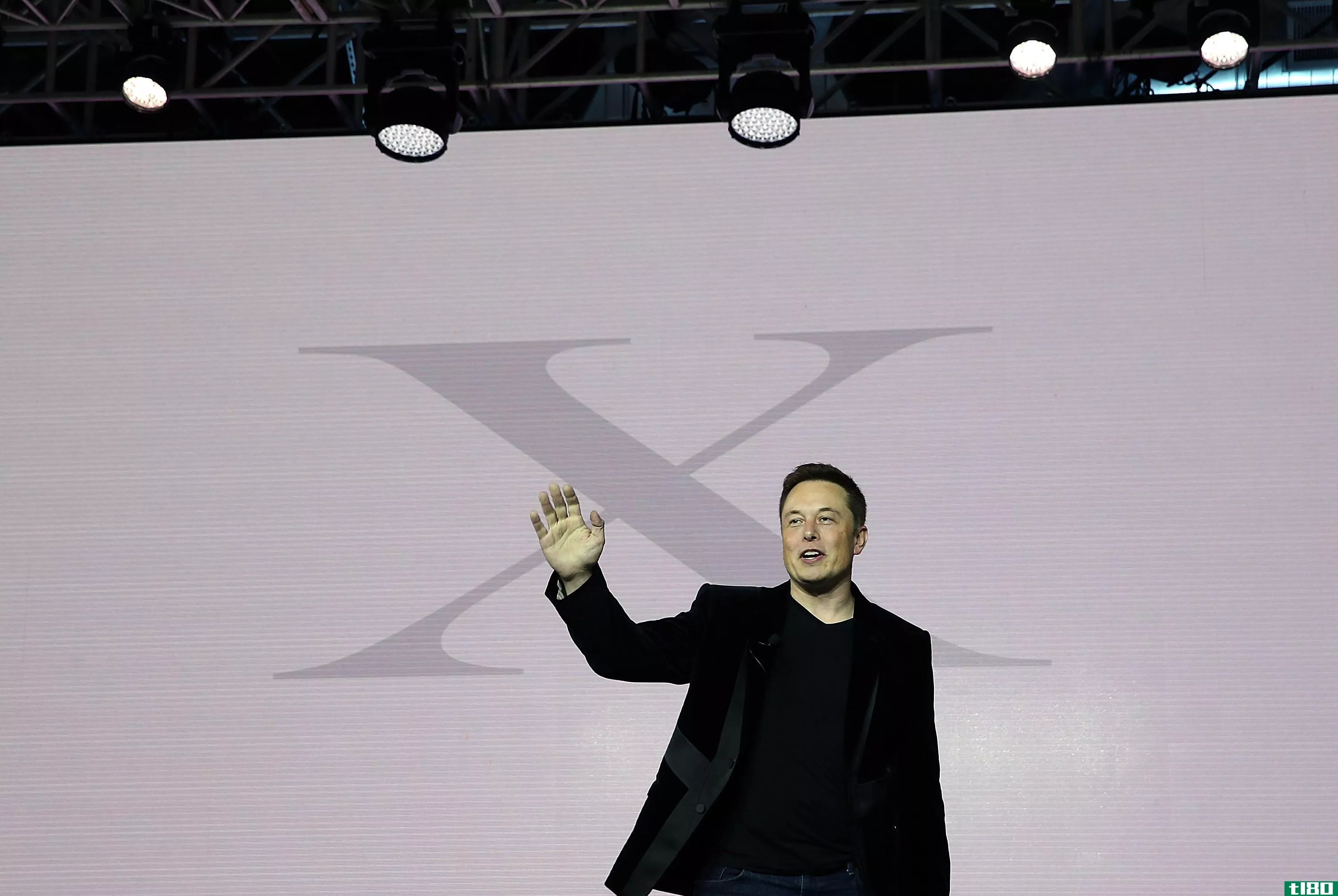

领先的人工智能研究人员警告说,“人工智能军备竞赛”可能会给人类带来灾难,并敦促联合国考虑禁止“进攻性自主武器”。这封***由未来生命研究所(FLI)发表,由斯蒂芬·霍金(Stephen Hawking)、埃隆·马斯克(Elon Musk)和诺姆·乔姆斯基(Noam Chomsky)等知名人士签署,警告说,自动“选择和打击目标而不需要人为干预”的武器可能成为“明天的卡拉什尼科夫”,助长战争、恐怖主义和全球不稳定。

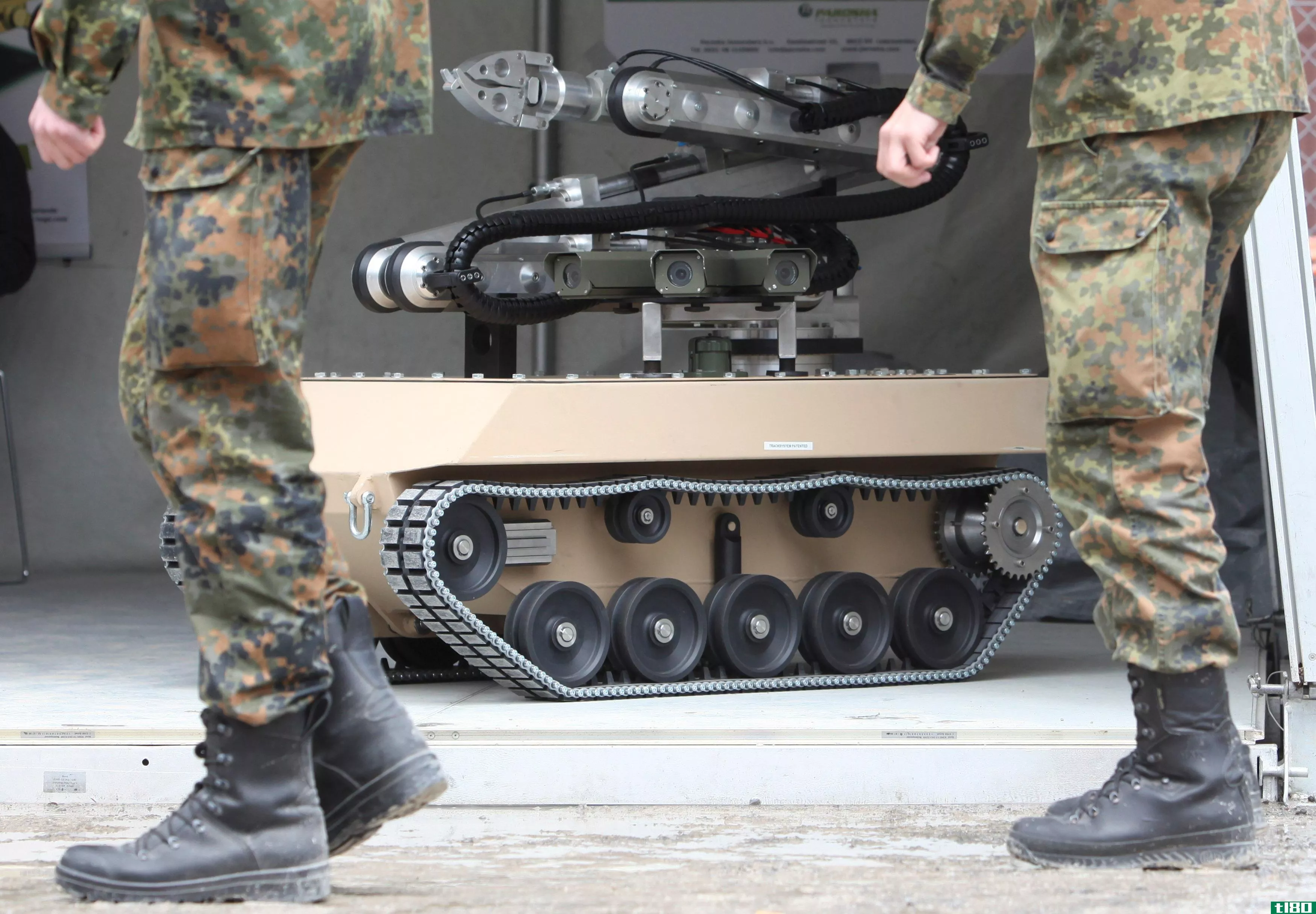

“人工智能(AI)技术已经到了这样一个地步,部署这样的系统在几年内,而不是几十年内实际上是可行的,如果不是法律上的话,”这封信以武装四架直升机(一种已经以非常粗糙的方式部署的技术)为例说。信中指出,尽管使用自主武器有可能减少战场上的人员伤亡,但这本身可能是一个错误,因为这将“降低”开战的门槛。

“自主武器是暗杀(和)破坏国家稳定的理想武器。”

信中说:“与核武器不同,(自主武器)不需要昂贵或难以获得的原材料,因此它们将变得无处不在,对所有重要军事大国大规模生产都是廉价的。”在他们出现在黑市和****手中、希望更好地控制民众的独裁者、希望进行种族清洗的军阀等手中只是时间问题。自主武器是暗杀、破坏国家稳定等任务的理想武器,制伏人口,选择性地杀害某一特定族群。”

对人工智能武器的强烈反对可能会阻碍研究

这封信最后警告说,自主武器的发展可能会玷污人工智能领域,并造成“重大公众反弹”,从而阻碍可能有益的人工智能研究。作者总结说,这“应该通过禁止人类无法控制的攻击性自主武器来防止”,并敦促联合国采取行动。

FLI并不是唯一在这一领域开展活动的组织,但半自主武器系统已经在扩散,随着美国空军预测“到2030年,机器能力将增加到人类将成为各种系统中最薄弱的组成部分。”批评者和支持者也指出,在什么是和什么不是自主武器系统的问题上,很难划清界限。

FLI***的其他签名人包括苹果联合创始人史蒂夫·沃兹尼亚克、Skype联合创始人贾恩·塔林和去年被谷歌收购的英国人工智能公司DeepMind的CEO黛米斯·哈萨比斯。FLI此前也发表过类似主题的***,包括今年1月的一封,呼吁研究人员关注人工智能的“社会效益”。

边缘视频:战争机器人

- 发表于 2021-04-30 21:12

- 阅读 ( 120 )

- 分类:互联网

你可能感兴趣的文章

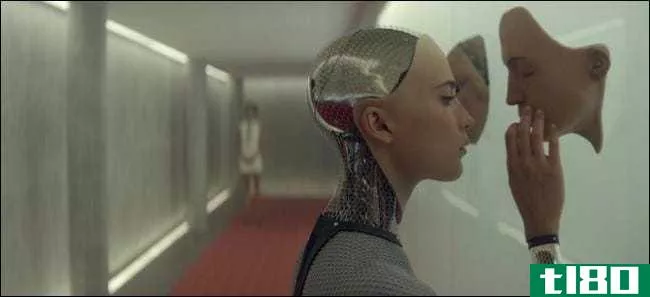

人工智能将如何改变我们的生活,是好是坏

...过去一年左右一直关注媒体,你可能会得到这样的印象:人工智能的威胁摧毁我们只是时间问题。 编者按:这与我们通常的操作方式和解释方式不同,我们让作者研究并提出发人深省的技术观点。 从大型暑期大片《复仇者:奥...

- 发布于 2021-04-10 05:46

- 阅读 ( 164 )

比尔·盖茨买了一辆保时捷,然后伊隆·马斯克说了他的坏话

...一辆保时捷旅行车。 当然,有人提醒伊隆·马斯克注意这一事态发展。这让马斯克在推特上发了一条恶毒的消息:“我和盖茨的对话让tbh没什么好感。”马斯克确实喜欢牛肉;毕竟,他对Facebook的马克·扎克伯格和亚...

- 发布于 2021-04-20 05:28

- 阅读 ( 166 )

诺姆·乔姆斯基参与了艾亚杜赖的电子邮件发明声明

著名语言学家和激进活动家诺姆·乔姆斯基(Noam Chomsky)为他的前学生V.A.Shiva Ayyadurai辩护’他声称发明了电子邮件。二月*****关于艾亚杜赖的报道’s的“电子邮件”计算机程序版权和他的作品’关于什么是“电子邮件”以及谁应...

- 发布于 2021-04-22 18:27

- 阅读 ( 113 )

埃隆·马斯克和科学家一致认为:我们需要确保人工智能帮助人类

世界各地的学者和专家呼吁建立人工智能的研究人员“不仅要让人工智能更具能力,而且要把注意力放在最大限度地发挥人工智能的社会效益上”,由未来生命研究所起草,由斯蒂芬霍金和埃隆·马斯克等领先的科学和行业人士...

- 发布于 2021-04-28 15:32

- 阅读 ( 129 )

史蒂芬·霍金下周要做他的第一个reddit-ama

如果你有一些关于人工智能的问题只能由理论物理领域的顶尖人才来回答,那你就走运了。史蒂芬·霍金下周将在他的第一个AMA会议上回答公众的问题——这个问题的处理方式将与他们通常在Reddit上的表现有所不同。霍金将从7月...

- 发布于 2021-04-30 20:48

- 阅读 ( 136 )

史蒂芬·霍金害怕有能力的机器,而不是恶意的机器

...it主办的第三大AMA,提交了9000多条评论。 人工智能已经成为美国医学协会(AMA)预定的重点,这是基于霍金今年夏天签署的***——以及诺姆·乔姆斯基(Noam Chomsky)和埃隆·马斯克(Elon Musk)等其他公众人物——...

- 发布于 2021-05-01 15:11

- 阅读 ( 149 )

微软知道我们将在机器人战争中失败,主张共存

...达了史蒂芬·霍金(Stephen Hawking)等受人尊敬的科学家对人工智能有一天可能消灭人类生命的真诚关切。 纳德拉指出,微软自己的人工智能助手科尔塔纳是我们早期与人工智能共存的一个积极例子。该工具跟踪微...

- 发布于 2021-05-04 01:35

- 阅读 ( 161 )

第一次点击:伊隆·马斯克想象民主后的生活

...成的集合体,由“头脑”管理和组织——难以置信的强大人工智能。头脑是如此的先进,以至于几乎无所不知,能够发动战争,管理生产,运作一个功能性的乌托邦社会,而不需要任何人的投入。人类甚至不需要创造新的思维—...

- 发布于 2021-05-08 15:57

- 阅读 ( 125 )