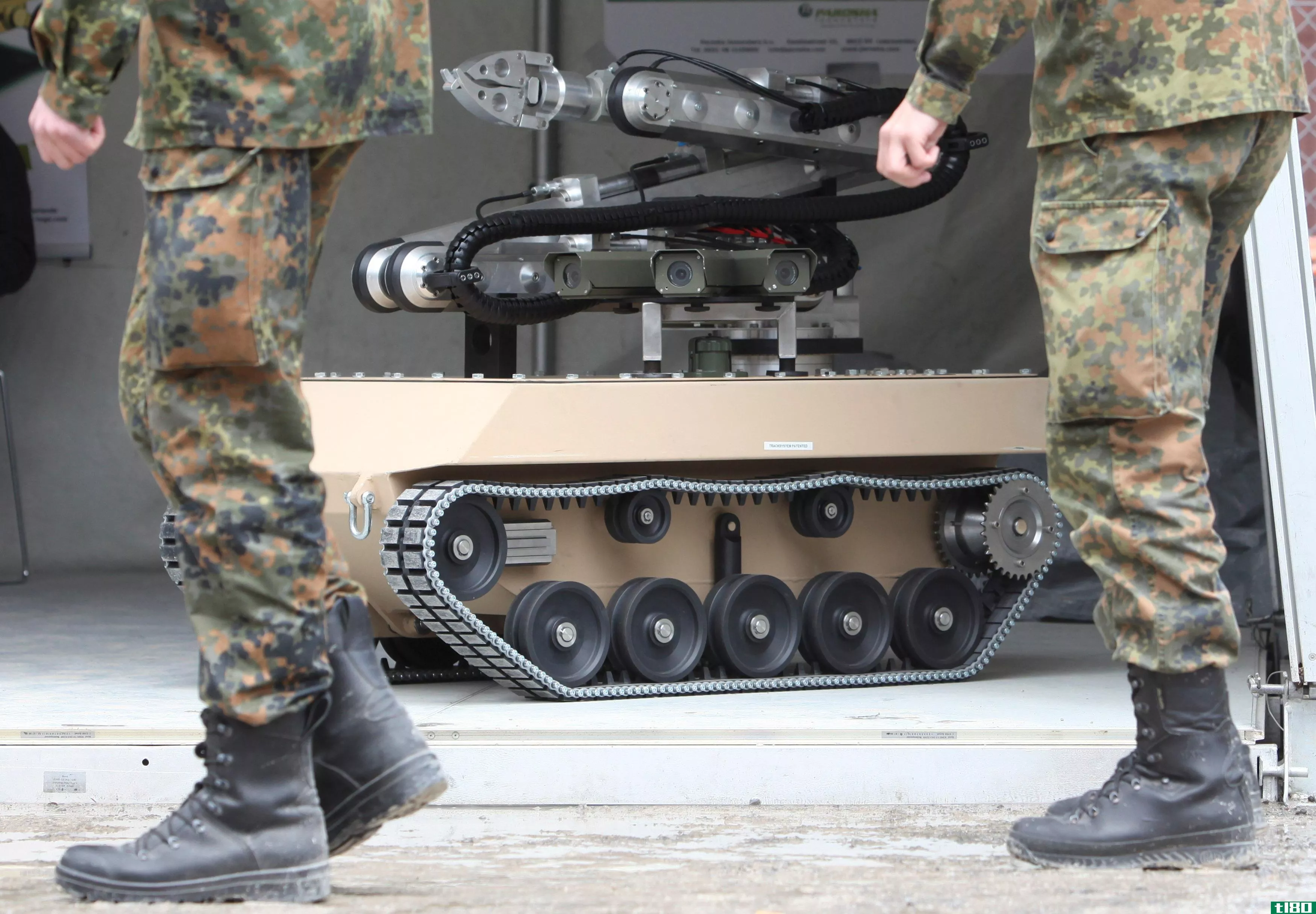

deepmind创始人埃隆·马斯克(elon musk)和其他人签署承诺,不开发致命的人工智能武器系统

包括埃隆·马斯克(Elon Musk)和谷歌人工智能子公司DeepMind的三位联合创始人在内的技术领袖签署了承诺,承诺不研发“致命的自主武器”

这是一个由研究人员和高管组成的非官方全球联盟反对传播此类技术的最新举措。誓言警告说,使用人工智能“在没有人为干预的情况下[选择]和[攻击]目标”的武器系统构成道德和现实威胁。签署国认为,从道德上讲,夺走人类生命的决定“永远不应该委托给机器”。在务实方面,他们说,此类武器的扩散将“对每个国家和个人造成危险的不稳定”

该承诺于今天在斯德哥尔摩举行的2018年国际人工智能联合会议(IJCAI)上发表,由生命未来研究所(Future of Life Institute)组织,该研究所旨在“缓解人类生存风险”。该研究所以前曾帮助一些来自同一个人的信件,呼吁联合国考虑所谓的致命自主武器或法律的新规定。然而,这是有关各方首次单独承诺不开发此类技术。

签署方包括SpaceX和特斯拉首席执行官埃隆·马斯克;谷歌DeepMind子公司的三位联合创始人Shane Legg、Mustafa Suleyman和Demis Hassabis;Skype创始人贾恩·塔林;以及一些世界上最受尊敬和杰出的人工智能研究人员,包括斯图尔特·拉塞尔、约书亚·本吉奥和尤尔根·施密杜伯。

该承诺的签字人、麻省理工学院物理学教授马克斯·特马克(Max Tegmark)在一份声明中表示,该承诺表明人工智能领导人“从谈话转向行动”。特马克说,该承诺做了政客们没有做的事情:对军用人工智能的发展施加硬限制自动决定杀人的武器和生物武器一样令人厌恶和破坏稳定,应该以同样的方式处理,”Tegmark说。

到目前为止,为自主武器的国际监管争取支持的努力都是徒劳的。活动家们建议,法律应该受到限制,类似于对化学武器和地雷的限制。但请注意,要在什么构成和什么不构成一个自治系统之间划清界限是非常困难的。例如,炮塔可以瞄准个人,但不能向他们开火,人类“在回路中”只是在其决定上打橡皮图章。

他们还指出,执行这些法律将是一个巨大的挑战,因为开发人工智能武器的技术已经非常普及。此外,参与开发这项技术最多的国家(如美国和中国)没有不这样做的真正动机。

军事分析师保罗·沙雷(Paul Scharre)撰写了一本关于战争和人工智能未来的书,他在《边缘》杂志上表示,这一承诺不太可能对国际政策产生影响,而且这些文件在挑拨这场辩论的复杂性方面做得不够好。”似乎缺少的是人工智能研究人员持续参与,向决策者解释他们为什么关注自主武器,”Scharre说。

他还补充说,大多数**都同意这项承诺的主要承诺——个人不应开发针对个人的人工智能系统——以及用于防御的军事人工智能的“猫已经出笼了”至少有30个国家监督了用于防御火箭和导弹攻击的自主武器真正的辩论是在中间空间,新闻发布有点含糊不清。

然而,尽管国际监管可能不会很快出台,但最近的事件表明,像今天的承诺这样的集体行动主义可以带来不同。例如,谷歌被披露正在帮助五角大楼开发非致命人工智能无人机工具后,遭到员工**。几周后,它发布了新的研究指南,承诺不开发人工智能武器系统。对韩国凯斯特大学的威胁性**也产生了类似的结果,凯斯特大学校长承诺不会开发“违背人类尊严,包括缺乏人类控制的自主武器”的军事人工智能

在这两种情况下,有理由指出,相关组织并没有阻止自己开发具有其他非致命用途的军事AI工具。但承诺不让电脑单独负责杀人总比根本不承诺要好。

承诺全文如下,签字人名单如下:

Artificial intelligence (AI) is poised to play an increasing role in military systems. There is an urgent opportunity and necessity for citizens, policymakers, and leaders to distinguish between acceptable and unacceptable uses of AI.

In this light, we the undersigned agree that the decision to take a human life should never be delegated to a machine. There is a moral component to this position, that we should not allow machines to make life-taking decisi*** for which others – or nobody – will be culpable.

There is also a powerful pragmatic argument: lethal autonomous weap***, selecting and engaging targets without human intervention, would be dangerously destabilizing for every country and individual. Thousands of AI researchers agree that by removing the risk, attributability, and difficulty of taking human lives, lethal autonomous weap*** could become powerful instruments of violence and oppression, especially when linked to surveillance and data systems.

Moreover, lethal autonomous weap*** have characteristics quite different from nuclear, chemical and biological weap***, and the unilateral acti*** of a single group could too easily spark an arms race that the international community lacks the technical tools and global governance systems to manage. Stigmatizing and preventing such an arms race should be a high priority for national and global security.

We, the undersigned, call upon governments and government leaders to create a future with strong international norms, regulati*** and laws against lethal autonomous weap***. These currently being absent, we opt to hold ourselves to a high standard: we will neither participate in nor support the development, manufacture, trade, or use of lethal autonomous weap***. We ask that technology companies and organizati***, as well as leaders, policymakers, and other individuals, join us in this pledge.

美国东部时间7月18日05:40更新:保罗·沙雷(Paul Scharre)对该报道进行了补充评论。

- 发表于 2021-08-24 21:24

- 阅读 ( 76 )

- 分类:互联网

你可能感兴趣的文章

埃隆·马斯克希望太阳能的未来能在美国建成

...步取消,**也希望对进口的中国面板征收关税。SolarCity的创始人表示,通过建立如此庞大的生产设施,他们希望能压低太阳能技术的价格,并在能源使用方面“取得突破”。 埃隆•马斯克(elonmusk)今年早些时候宣布了一项...

- 发布于 2021-04-26 16:58

- 阅读 ( 135 )

埃隆·马斯克说,人工智能“可能比核武器更危险”

...。”这位亿万富翁发明家喜欢让不可能成为可能,但他对人工智能(AI)深感恐惧。本周末,马斯克在推特上说,“我们需要对人工智能格外小心”,并补充说人工智能“可能比核武器更危险” 如果这还不够令人...

- 发布于 2021-04-27 00:43

- 阅读 ( 191 )

埃隆·马斯克说,自动驾驶汽车技术还有5到6年的时间

...年前,特斯拉宣布了开发自动驾驶汽车技术的计划,现在创始人兼首席执行官埃隆·马斯克(Elon Musk)表示,在这成为现实之前,还有相当多的工作要做。准确地说,还有5到6年。马斯克在接受《华尔街日报》采访时说,实现这...

- 发布于 2021-04-27 12:04

- 阅读 ( 157 )

马斯克、霍金和乔姆斯基警告说,由人工智能推动的机器人战争即将来临

领先的人工智能研究人员警告说,“人工智能军备竞赛”可能会给人类带来灾难,并敦促联合国考虑禁止“进攻性自主武器”。这封***由未来生命研究所(FLI)发表,由斯蒂芬·霍金(Stephen Hawking)、埃隆·马斯克(Elon Musk)和...

- 发布于 2021-04-30 21:12

- 阅读 ( 136 )

史蒂芬·霍金害怕有能力的机器,而不是恶意的机器

...it主办的第三大AMA,提交了9000多条评论。 人工智能已经成为美国医学协会(AMA)预定的重点,这是基于霍金今年夏天签署的***——以及诺姆·乔姆斯基(Noam Chomsky)和埃隆·马斯克(Elon Musk)等其他公众人物——...

- 发布于 2021-05-01 15:11

- 阅读 ( 173 )

埃隆·马斯克的非营利组织希望ais能为atari的高分而竞争

...棋。希望这些任务能给OpenAI和其他人一种排序和改进各种人工智能方法的方法,有可能引导他们找到教机器全面学习的新方法。 这些环境还包括59个不同的经典雅达利游戏,包括太空入侵者,吃豆人,陷阱,Qbert...

- 发布于 2021-05-04 10:02

- 阅读 ( 177 )

埃隆·马斯克(elon musk)在推特草稿中保留了他对特朗普移民禁令最严厉的批评

SpaceX和特斯拉首席执行官埃隆·马斯克(Elon Musk)发推特,然后很快删除了三条谴责特朗普总统今天关于移民的行政命令的推特。这些推特的语气比马斯克1月28日发表的声明要严厉得多。删除这些推文后不久,马斯克向一位好奇...

- 发布于 2021-05-09 21:55

- 阅读 ( 192 )

埃隆·马斯克推出了neuralink,这是一项将人脑与人工智能相结合的项目

...植入人脑的设备,最终目的是帮助人类与软件融合,跟上人工智能的进步。这些增强可以改善内存或允许与计算设备进行更直接的接口。 马斯克在过去六个月左右的时间里曾多次暗示过神经苷的存在。最近,马斯克...

- 发布于 2021-05-10 11:43

- 阅读 ( 133 )

elon musk的neuralink并不是要阻止人工智能的末日

...俱乐部疯了。理论范围从这是马斯克的大胆计划,以防止人工智能的启示,更多的测量反应,这是一个有希望的贡献,治疗神经退行性疾病。有些人还半开玩笑地指责马斯克在周末玩了太多的大众效应:仙女座。 但...

- 发布于 2021-05-10 12:05

- 阅读 ( 164 )

埃隆·马斯克在与特朗普通话后对巴黎气候协议“谨慎乐观”

SpaceX首席执行官埃隆·马斯克(Elon Musk)在推特上表示,他三周前与总统唐纳德·特朗普(Donald Trump)就巴黎气候协议进行了交谈,现在对即将做出的是否退出的决定“谨慎乐观”。特朗普的竞选承诺之一是退出气候协议,这是...

- 发布于 2021-05-11 07:34

- 阅读 ( 177 )