科技行业没有一个解决面部识别偏见的计划

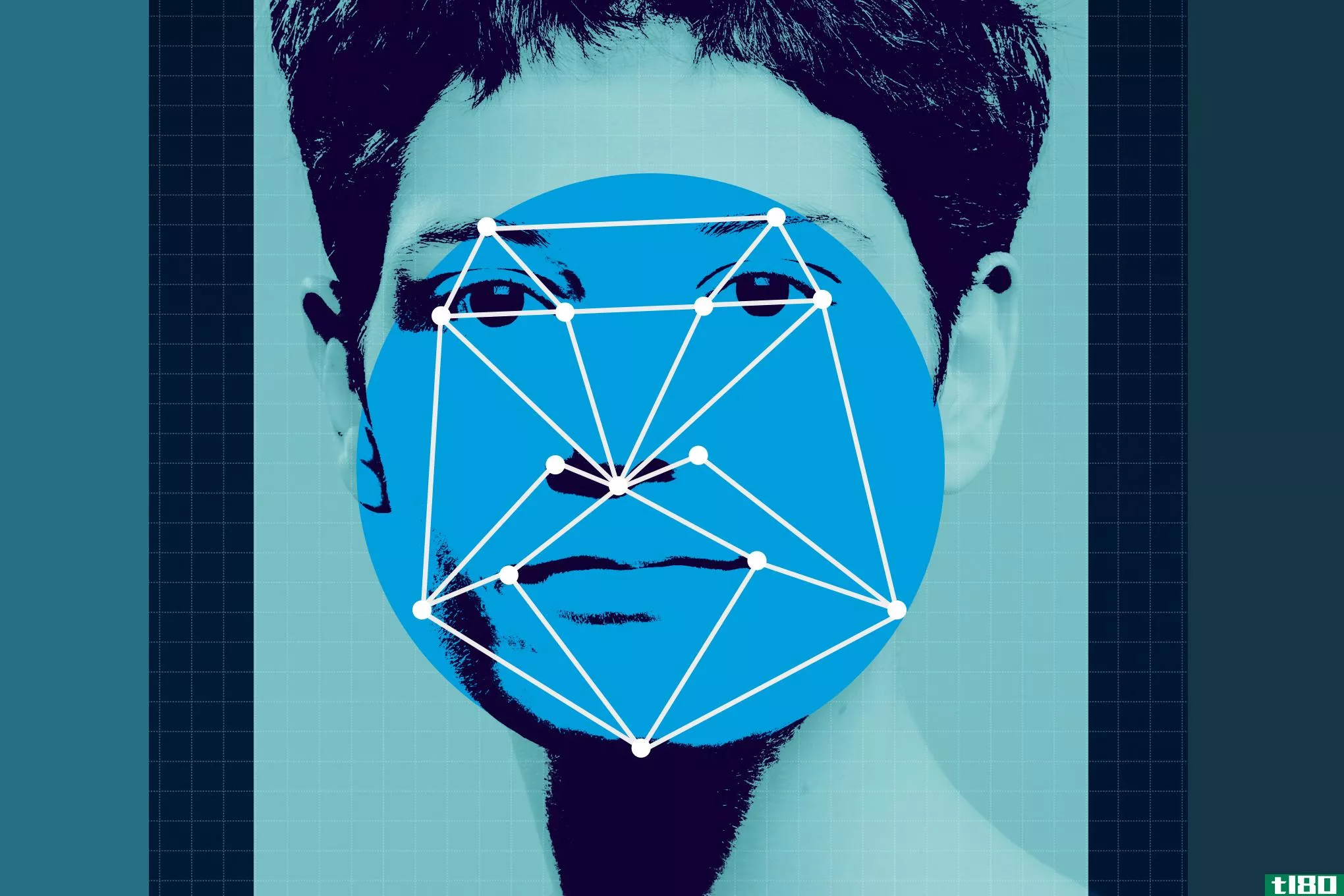

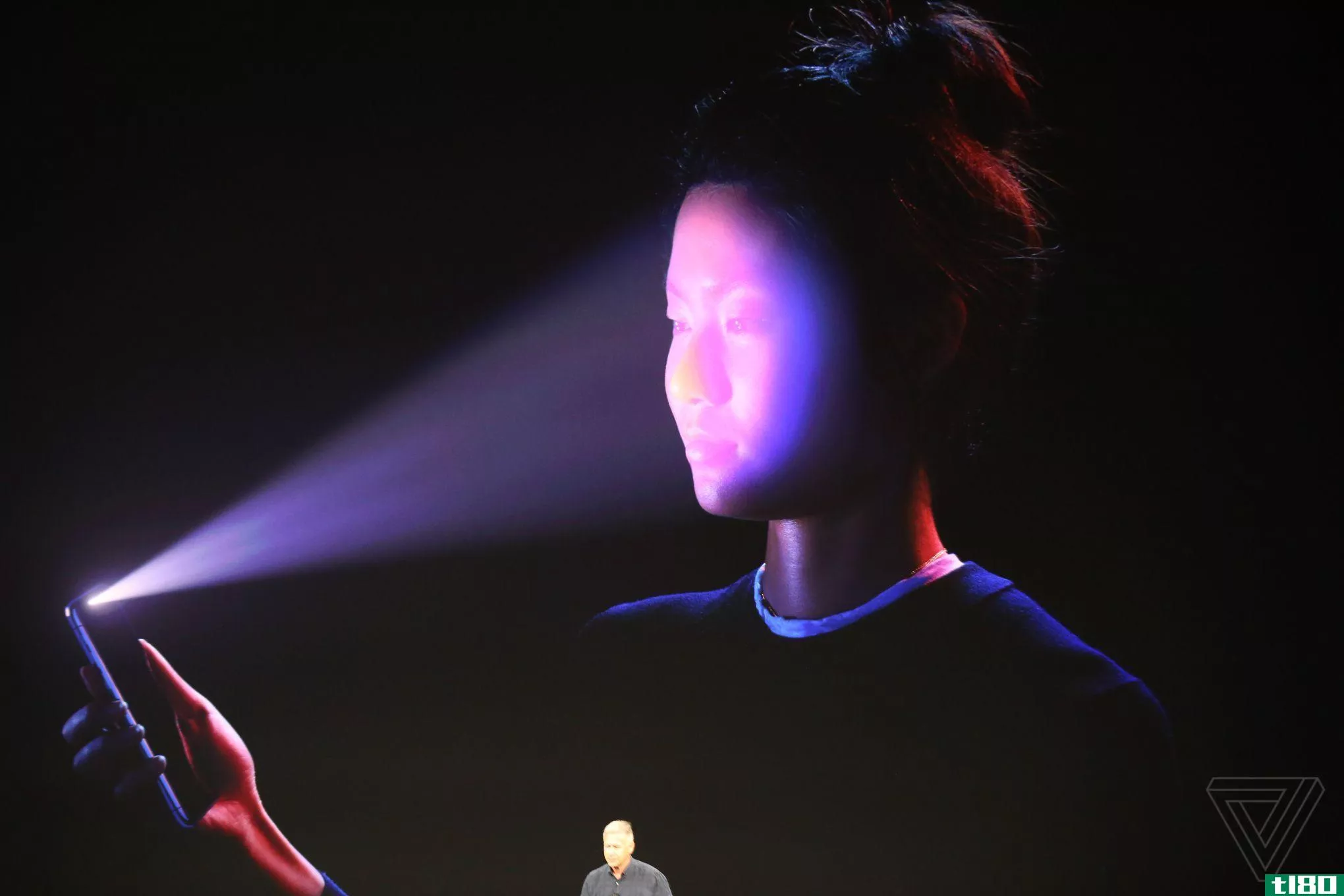

面部识别正在成为日常生活的一部分。您可能已经使用它登录到您的**或计算机,或向您的银行验证付款。在中国,这项技术更为普遍,你的脸可以用来买快餐,或者在公共厕所领取卫生纸。这更不用说世界各地的执法机构如何将面部识别作为大规模监视工具进行试验了。

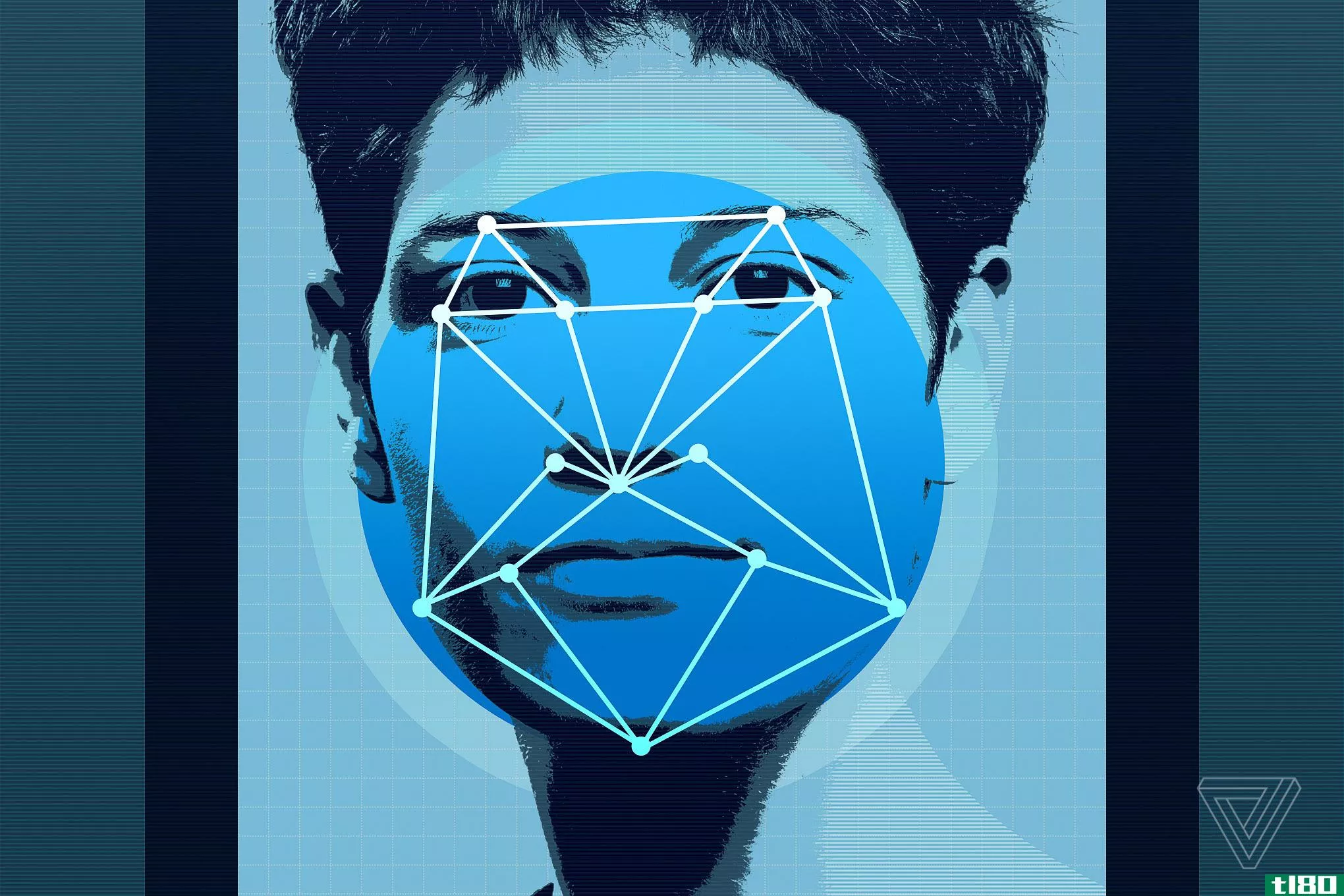

但这项技术的广泛应用掩盖了潜在的结构性问题,尤其是偏见问题。研究人员的意思是,用于面部识别、识别或分析的软件根据其识别的人的年龄、性别和种族表现不同。

麻省理工学院媒体实验室的研究人员在二月份发表的一项研究发现,由IBM、微软和Face++设计的面部识别算法在检测肤色较深的**性别时,与肤色较浅的**相比,错误率高达35%。这样,面部识别的偏见就有可能强化社会的偏见;对妇女和少数群体的影响不成比例,有可能将她们排斥在世界数字基础设施之外,或对她们做出改变生活的判断。

这是个坏消息。更坏的消息是,公司还没有解决这个问题的计划。尽管个别公司正在解决自己软件中的偏见问题,但专家表示,没有任何基准可以让公众在整个行业范围内跟踪改进情况。因此,当公司确实减少了算法中的偏差时(正如微软上个月宣布的那样),很难判断这有多大意义。

乔治敦大学隐私与技术中心的同事克莱尔·加维(Clare Garvie)告诉《边缘》(The Verge)杂志,许多人认为是时候引入全行业的偏见和准确性基准了:测试算法在不同人口统计数据(如年龄、性别和肤色)上的表现。”我认为这将是非常有益的,”加维说特别是那些将与**机构签订合同的公司。”

什么是这些公司在做什么(the companies doing)?

在一项非正式调查中,Verge联系了十几家销售面部识别、识别和分析算法的公司。所有回复的公司都表示,他们意识到了偏见的问题,大多数公司表示,他们正在尽最大努力在自己的系统中减少偏见。但没有人会分享他们工作的详细数据,也不会透露自己的内部指标。如果你经常使用面部识别算法,你不想知道它对你的性别或肤色的影响是否会持续恶化吗?

谷歌只销售能够检测人脸而非其身份的算法,他说:“我们会测试偏见,我们会不断测试我们的基本模型,以减少偏见,提高公平性。目前我们没有更多的细节可供分享。”

微软指出了其最近的改进,包括其性别识别软件,该软件目前对肤色较深的**的错误率为1.9%(低于20.8%)。该公司没有发表官方评论,但提到了其首席法律官布拉德·史密斯(Brad Smith)7月份的一篇博客文章。史密斯在《*****》中表示,美国**现在应该对自己使用面部识别进行监管,尽管不是由私人公司使用。可能包括设定最低精度标准。

IBM还强调了最近的改进,以及上个月发布的用于训练面部识别系统的多样化数据集,旨在打击偏见。IBM Watson的首席架构师Ruchir Puri在6月份告诉Verge,该公司有兴趣帮助建立准确度基准。”“应该有矩阵,通过它可以判断这些系统中的许多,”普里说但评判应该由社区来进行,而不是由任何特定的参与者来进行。”

亚马逊也没有对这些问题做出回应,但向我们介绍了它在今年早些时候发表的声明。此前,亚马逊因向执法部门**面部识别而受到美国公民自由联盟(ACLU)的批评(美国公民自由联盟(ACLU)今天也提出了类似的批评:它测试了该公司的面部识别软件,以识别国会议员的照片,发现他们错误地将28个人与犯罪抢劫照片进行了匹配。)

亚马逊表示,如果用户被用来非法歧视或侵犯公众隐私权,它将撤回用户对其算法的访问,但没有提及任何形式的监督。该公司告诉Verge,其内部有团队在测试并消除其系统中的偏见,但不会分享任何进一步的信息。考虑到亚马逊继续向执法机构**其算法,这一点值得注意。

在Verge接触的企业供应商中,有些根本没有提供直接响应,包括FaceFirst、Gemalto和NEC。其他人,如向世界各地的执法和边境机构销售面部识别算法的德国公司Cognitec,承认如果没有正确的数据,避免偏见是很困难的。

Cognitec的营销经理Elke Oberg告诉Verge,“现有的数据库往往存在偏见。”他们可能只是白人,因为这是供应商提供的任何模型。”奥伯格说,Cognitec尽最大努力在不同的数据上进行培训,但表示市场力量将淘汰不好的算法。”所有的供应商都在努力解决这个问题,因为公众已经意识到了这一点我认为,如果你想作为一个供应商生存下去,你肯定需要在高度多样化的数据上训练你的算法。”

我们如何解决偏见问题?

这些答案表明,尽管人们意识到了偏见的问题,但并没有协调一致的反应。那怎么办呢?大多数专家建议的解决方案在概念上很简单,但很难实现:创建行业范围的准确性和偏差测试。

有趣的是,这样的测试已经存在了。它被称为FRVT(人脸识别供应商测试),由国家标准与技术研究所(NIST)管理。它在不同的场景下测试了几十个人脸识别系统的准确性,比如将护照照片与站在边境大门处的人进行匹配,或者将CCTV镜头中的人脸与数据库中的照片进行匹配。它还测试了“人口差异”——基于性别、年龄和种族的算法表现。

然而,FRVT完全是自愿的,提交算法的组织往往要么是试图向联邦****服务的企业供应商,要么是测试新的实验模型的学者。像NEC和Gemalto这样的小公司提交了他们的算法,但没有一家大型商业科技公司提交。

Garvie建议,与其创建新的面部识别准确度测试,不如扩大FRVT的范围。”“NIST在进行这些测试方面做得非常出色,”加维说[但他们的资源也很有限。我怀疑我们需要立法或联邦资金支持,以提高NIST测试其他公司的能力。”另一个挑战是,亚马逊和微软等公司部署的深度学习算法无法轻易发送进行分析。它们是不断更新的软件的巨大组成部分;与旧的面部识别系统非常不同,后者通常可以安装在一个拇指驱动器上。

NIST的生物识别标准和测试负责人Patrick Grother在对Verge发表讲话时明确表示,该组织目前的角色不受监管。”我们不做监管,也不做政策。我们只是生产数字,”格罗瑟说。近20年来,NIST一直在测试人脸识别算法的准确性,目前正在编写一份报告,专门讨论偏见问题,该报告将于今年年底提交。

Grother说,尽管自NIST开始测试以来“误差大幅减少”,但不同算法的性能之间仍然存在很大差异。”并不是每个人都能做面部识别,但很多人认为他们能,”他说。

格罗瑟说,最近关于偏见的讨论经常混淆不同类型的问题。他指出,尽管训练数据集缺乏多样性会产生偏见,但拍摄对象的糟糕照片也会产生偏见,尤其是当他们的肤色没有适当暴露时。同样,当应用于不同类型的任务时,不同类型的错误意味着更多。任何基准或监管都需要考虑所有这些微妙之处。

偏见不是唯一的问题

但是关于偏见的讨论引发了关于社会使用面部识别的其他问题。为什么要担心这些工具的准确性,而更大的问题是它们是否会被用于**监督和针对少数民族?

Joy Buolamwini是麻省理工学院关于性别识别算法中不同准确率的研究报告的合著者,他告诉《电子邮件边缘》杂志,仅仅纠正偏见并不能完全解决这些更广泛的问题。”布奥兰维尼说:“发展面部分析技术并将其武器化有什么好处?”需要一种更全面的方法,将面部分析技术问题视为一个社会技术问题。技术考虑不能脱离社会影响。”

Buolamwini和AI社区的其他一些人在这些问题上采取了积极的立场。面部识别供应商Kairos的首席执行官布莱恩·布拉基恩(Brian Brackeen)最近宣布,他的公司根本不会向执法部门**面部识别系统,因为可能存在误用。

Brackeen对Verge说,当涉及到人脸识别的商业部署时,市场力量将有助于消除有偏见的算法。但是,他说,当**使用这些工具时,风险要高得多。这是因为联邦机构可以访问更多的数据,增加了这些系统被用于压制性监视的可能性(据估计,美国**拥有全国一半成年人口的面部数据。)同样,**使用这些算法做出的决定将对个人的生活产生更大的影响。

“用于执法的用例不仅仅是街上的摄像机;这是人体摄像头,面部照片,排队,”Brackeen说。他说,如果偏见是这些场景中的一个因素,那么“有色人种有更大的机会被诬告犯罪。”

因此,关于偏见的讨论似乎只是一场更大辩论的开始。正如Buolamwini所说,基准可以发挥作用,但还需要做更多的工作:“开发这些工具的公司、研究人员和学术界必须承担责任,对他们开发的系统施加环境限制,如果他们想减轻危害的话。”

- 发表于 2021-08-24 23:57

- 阅读 ( 97 )

- 分类:互联网

你可能感兴趣的文章

科技公司如何误导你做出错误的隐私选择

...者委员会(Norwegian C***umer Council)最近的一份报告显示,科技公司正在误导你放弃对你的数据的权利。 ...

- 发布于 2021-03-24 06:58

- 阅读 ( 216 )

因为测试软件看不到有色人种的学生,有色人种的学生被老师盯上了

...让软件识别他们。这可能会引起学生的问题:如果Proctorio没有检测到他们的脸,它会把他们标记给老师。 在轶事般地听说了这些问题后,Akash Satheesan决定研究一下该软件使用的面部检测方法。他发现,它的外观和性能与OpenCV完...

- 发布于 2021-04-15 20:59

- 阅读 ( 174 )

英特尔推出了realsense id,面部识别技术,该技术使用了该公司的深度传感摄像头

...用可以用于多种设置,比如atm、寄存器和智能锁。该公司没有提到的是面部识别的另一个流行用途:**和执法机构跟踪和分析人们。 就在去年,华为公司开发的面部识别软件被用于追踪中国受迫害的***族少数民族。去年夏天,在...

- 发布于 2021-04-16 16:06

- 阅读 ( 172 )

马萨诸塞州即将成为第一个禁止警察使用面部识别的州

...在等待马萨诸塞州州长查理·贝克的签署。 在人工智能行业和更广泛的技术政策领域,人脸识别的使用已经成为一个有争议的话题,因为缺乏联邦**对其使用的指导。这一真空使得许多公司——最具争议的Clearview AI公司——介入...

- 发布于 2021-04-16 23:50

- 阅读 ( 229 )

亚马逊的掌上阅读是从杂货店开始的,但它的规模可能要大得多

... 尽管亚马逊一号最初将只用于支付,但很明显,这家科技巨头对这一硬件有更大的野心。该公司表示,未来亚马逊One不仅可以用于购物,还可以替代音乐和体育赛事的门票,还可以替代你的办公钥匙卡,让你用手一扫就能进...

- 发布于 2021-04-17 11:42

- 阅读 ( 137 )

ibm将不再提供、开发或研究面部识别技术

...亚马逊是为数不多的向执法部门销售面部识别软件的主要科技公司之一。然而,该项目的名称Rekognition也因其准确性而受到批评。2018年,美国公民自由联盟(American Civil Liberties Union)发现,Rekognition错误地将28名国会议员与25000张...

- 发布于 2021-04-19 01:49

- 阅读 ( 212 )

亚马逊明年禁止警方使用其面部识别技术

...2018年被广泛引用的论文发现,包括IBM和微软在内的主要科技公司的面部识别系统识别深色皮肤个体的错误率比识别白色皮肤个体的错误率高出数十个百分点。《****》的一篇报道称,问题部分在于用于训练这些系统的数据集,其...

- 发布于 2021-04-19 02:14

- 阅读 ( 212 )

在国会通过新的隐私法之前,微软不会向警方出售面部识别系统

...察**的**活动中,以及一场关于种族不公的全民对话中,科技行业正在考虑自己在为执法机构提供不受监管、可能带有种族偏见的技术方面的角色。 研究表明,由于面部识别系统是使用由白人**组成的数据集进行训练的,因此识...

- 发布于 2021-04-19 02:25

- 阅读 ( 204 )

人工智能专家说,对声称能预测犯罪行为的算法的研究必须结束

...·弗洛伊德引发的种族正义问题。在这些**活动中,主要科技公司也撤回了使用面部识别系统的计划,黑人学者的研究表明,这种做法带有种族偏见。 这封信的作者和签名者呼吁人工智能界重新考虑如何评估其工作的“优点”—...

- 发布于 2021-04-19 04:37

- 阅读 ( 191 )

一个黑人因面部识别错误被捕

...的故事发生之际,包括IBM、微软和亚马逊在内的多家知名科技公司宣布,他们将停止或暂停面向警方的面部识别工作。IBM首席执行官Arvind Krishna在本月早些时候的一份声明中说:“我们认为,现在是开始全国对话的时候,讨论国...

- 发布于 2021-04-19 04:41

- 阅读 ( 183 )