人工智能研究人员说,当算法出错时,我们需要更多的力量进行反击

**和私人公司正在快速部署人工智能系统,但公众缺乏在这些系统出现故障时追究其责任的工具。这是AI Now发布的一份新报告中的主要结论之一。AI Now是一个研究小组,其成员来自微软和谷歌等科技公司,隶属于纽约大学。

该报告探讨了人工智能和算法系统的社会挑战,研究人员称之为“责任差距”,因为这项技术“跨核心社会领域”集成。他们提出了十项建议,包括呼吁**监管面部识别(微软总裁布拉德·史密斯也在本周倡导这一点)和针对人工智能产品的“广告真实性”法律,这样公司就不能简单地利用这项技术的声誉来销售他们的服务。

大型科技公司发现自己陷入了人工智能的淘金热,他们冲进了从招聘到医疗保健等广泛的市场,销售他们的服务。但是,正如AI现任联合创始人、谷歌开放研究小组负责人梅雷迪斯·惠塔克(Meredith Whittaker)对《边缘》(The Verge)所说,“他们关于利益和效用的许多主张都没有得到公开的科学证据的支持。”

Whittaker举了IBM的Watson系统为例,根据泄露的内部文件,该系统在纪念斯隆·凯特林癌症中心的试验诊断中给出了“不安全和不正确的治疗建议”Whittaker说:“他们的营销部门对[他们的技术]近乎神奇的特性所作的声称从未得到同行评议研究的证实。”。

《AI Now》报告的作者说,这起事件只是2018年**和大型科技公司部署的AI和算法系统的“连锁反应丑闻”之一。其他指控包括Facebook帮助促成缅甸种族灭绝,据透露,作为Maven项目的一部分,谷歌正在帮助军方为无人机构建人工智能工具,以及剑桥分析公司丑闻。

在所有这些案例中,硅谷最有价值的公司都遭到了公众的强烈**和内部的异议。这一年,谷歌员工因公司五角大楼合同而辞职,微软员工向公司施压,要求其停止与移民和海关执法局(ICE)的合作,谷歌、优步、eBay和Airbnb的员工**,**涉及性骚扰的问题。

惠塔克说,这些**活动得到了劳工联盟和AI Now’s own等研究计划的支持,已经成为“一股出乎意料的、令人满意的公众问责力量”

但报告很明确:公众需要更多。当**采用自动决策系统(ADS)时,对公民正义的威胁尤其明显。其中包括用于计算监狱刑期和分配医疗援助的算法。报告作者说,通常情况下,软件被引入这些领域是为了降低成本和提高效率。但这一结果往往导致系统做出无法解释或上诉的决定。

AI Now的报告列举了许多例子,包括患有脑瘫的阿肯色州居民塔米·多布斯(Tammy Dobbs),她在没有任何解释的情况下,将医疗补助计划提供的家庭护理从每周56小时减少到32小时。法律援助成功地起诉了阿肯色州,算法分配系统被判违宪。

惠塔克和人工智能的同事、微软研究员凯特·克劳福德(Kate Crawford)表示,将广告整合到**服务中的速度已经超过了我们审计这些系统的能力。但是,他们说,可以采取具体步骤来纠正这一问题。这些措施包括要求向****服务的技术供应商放弃贸易保密保护,从而使研究人员能够更好地检查他们的算法。

克劳福德说:“你必须能够说,‘你被切断了医疗补助,原因就在这里,’而黑匣子系统是做不到这一点的。”如果我们想让公众承担责任,我们必须能够审计这项技术。”

他们说,另一个需要立即采取行动的领域是面部识别和情感识别。在中国、美国和欧洲,警察部队越来越多地使用前者。例如,亚马逊的Rekognition软件已经由奥兰多和华盛顿县的警方部署,尽管测试表明,该软件在不同种族中的表现可能有所不同。在一项使用Rekognit识别国会议员的测试中,非白人议员的错误率为39%,而白人议员的错误率仅为5%。对于情感识别,公司声称技术可以扫描某人的脸,读取他们的性格甚至意图,AI Now的作者说,公司经常兜售伪科学。

尽管存在这些挑战,惠塔克和克劳福德表示,2018年已经表明,当人工智能的责任和偏见问题暴露出来时,技术员工、立法者和公众愿意采取行动,而不是默许。

关于硅谷最大的公司酝酿的算法丑闻,克劳福德说:“他们的‘快速行动,打破现状’思想已经打破了许多我们非常珍视的东西,现在我们必须开始考虑公众利益。”

惠塔克说:“你所看到的是,人们意识到网络乌托邦式的技术修辞与这些技术在日常生活中的实际应用之间的矛盾。”

- 发表于 2021-08-26 22:57

- 阅读 ( 94 )

- 分类:互联网

你可能感兴趣的文章

deepfakes解释说:制作假视频的人工智能太有说服力了

...货”两个词的组合。这是因为受过图像和视频合成训练的人工智能软件创造了这些视频。这个人工智能可以将一个物体(源)的脸叠加到另一个物体(目标)的视频上。更先进的技术形式可以利用信息源的面部姿势和他们想要模...

- 发布于 2021-03-22 15:45

- 阅读 ( 197 )

什么是机器学习算法?他们是这样工作的

人工智能和机器学习产生了我们今天在技术工业中看到的许多进步。但是机器是如何被赋予学习能力的呢?此外,我们这样做的方式是如何导致意想不到的后果的? ...

- 发布于 2021-03-23 07:51

- 阅读 ( 164 )

rpg游戏开发中的6项关键技术

...解构成rpg的最重要的机制都是值得的。从游戏设计软件到人工智能和随机数生成器,我们已经将这些机制分解出来供您探索。 ...

- 发布于 2021-03-28 08:09

- 阅读 ( 539 )

有人能分辨出他们是假的吗?

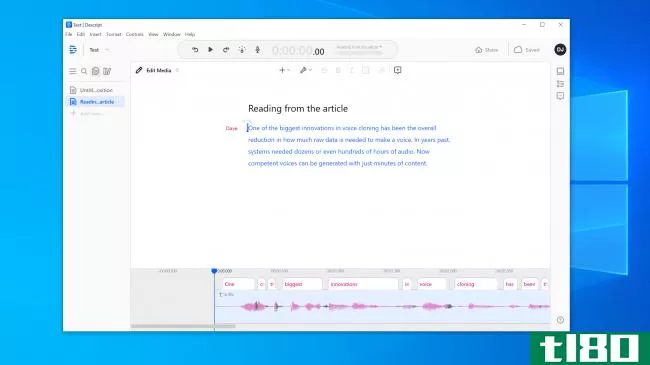

...克隆目前正处于发展阶段,许多公司正在开发工具。类似人工智能和描述有在线演示任何人都可以尝试免费。你只需录制屏幕上出现的短语,几分钟后,你的声音模型就被创建出来了。 你可以特别感谢人工智能,深度学习算法...

- 发布于 2021-04-01 21:18

- 阅读 ( 142 )

mozilla需要你的帮助来修复糟糕的youtube推荐

...有害内容推荐频率的模式。 博伊德说:“我希望人们对人工智能和推荐系统如何影响他们的生活更感兴趣。”。“不一定要神秘,我们可以更清楚地知道你如何控制它。” 博伊德强调,用户隐私在整个过程中都受到保护。Mozilla...

- 发布于 2021-04-17 22:15

- 阅读 ( 135 )

一个机器学习工具能(也不能)告诉我们什么是人工智能偏见

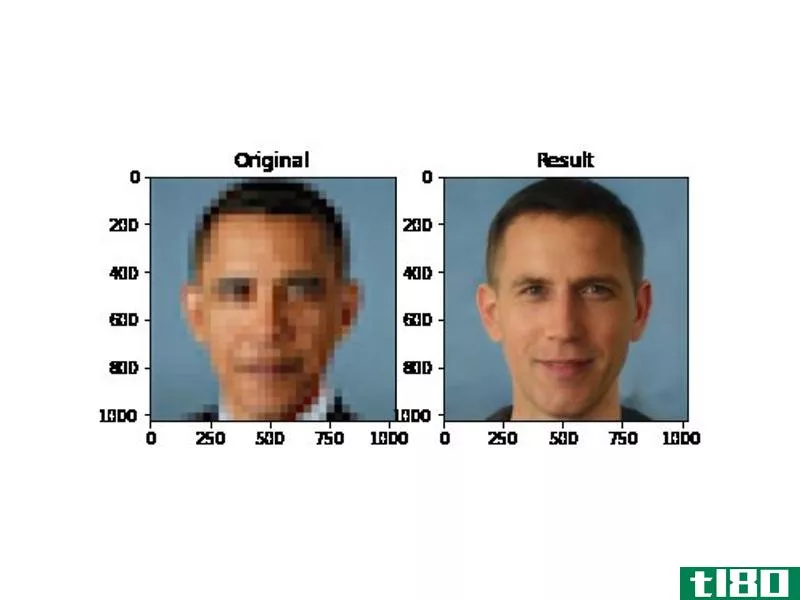

这是一个惊人的图像,说明了人工智能研究根深蒂固的偏见。将美国第一位黑人总统巴拉克奥巴马(Barack Obama)的一张低分辨率照片输入到一个算法中,该算法设计用于生成不相关的人脸,输出的是一个白人。 也不...

- 发布于 2021-04-19 04:02

- 阅读 ( 148 )

facebook正在分发它用来理解照片中物体的软件

...,可以识别照片中物体的种类和形状。这些工具由Facebook人工智能研究(FAIR)团队开发,被称为DeepMask、SharpMask和MultiPathNet,这三种工具协同工作,帮助分解图像的内容并将其上下文化。这些技术虽然目前还没有在Facebook消费类...

- 发布于 2021-05-07 04:02

- 阅读 ( 149 )

这个谷歌人工智能视频分类器很容易被潜意识的图像愚弄

...,作为回应,各品牌纷纷推出广告活动,而谷歌则将更多人工智能资源用于验证视频内容。但问题是,这家搜索巨头目前的算法可能无法胜任这项任务。 华盛顿大学最近发表的一篇由Quartz发现的研究论文明确了这个...

- 发布于 2021-05-10 14:04

- 阅读 ( 120 )

人工智能在学习人类书写的东西时会发现种族和性别偏见

研究人员说,人工智能在从文本中学习语言时会发现种族和性别偏见。在没有任何监督的情况下,机器学习算法学会了将**名字与家庭词汇相关联,而不是与职业词汇相关联,将黑人名字与白人名字相关联。 在今天发...

- 发布于 2021-05-10 17:27

- 阅读 ( 218 )

谷歌的下一代人工智能培训系统速度惊人

...用于机器学习的专用芯片,去年被展示出来,是由Apple的人工智能系统用来作为其预测和决策技能的基础。每次有人向谷歌的搜索引擎输入一个查询时,谷歌也会使用TPUs的计算能力。最近,这项技术已经被应用到机器学习模型中...

- 发布于 2021-05-11 05:26

- 阅读 ( 169 )