线性回归(linear regression)和逻辑回归(logistic regression)的区别

线性回归和逻辑回归是两种常用的回归分析技术,用于分析金融和投资领域的数据集,帮助管理者做出明智的决策。线性回归和逻辑回归是一种最简单的机器学习算法,属于监督学习技术,用于分类和回归问题的求解。回归中有两个重要变量;它们包括因变量和独立变量。因变量是您试图理解的主要变量,而自变量由可能对因变量产生重大影响的因素组成。

什么是线性回归(linear regression)?

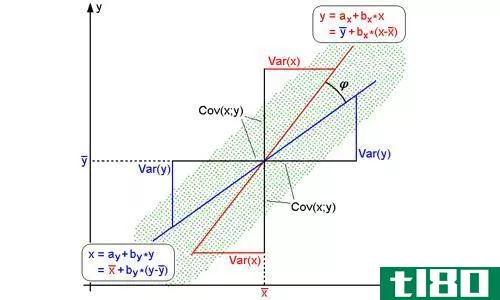

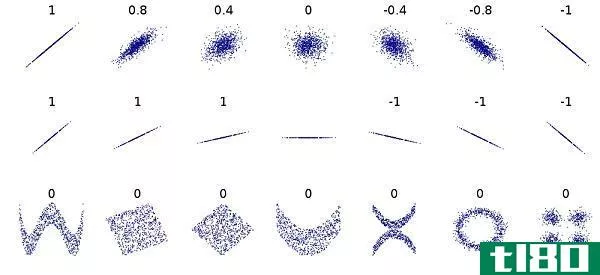

线性回归是一种回归分析技术,使用直线建立两个变量之间的关系。线性回归试图通过找到斜率和截距来绘制最接近数据的直线,从而定义直线并将回归误差降至最低。如果使用一个独立变量估计输出,则分析称为简单线性回归,而如果使用两个以上的独立变量估计输出,则此类回归分析称为多线性回归。

多元回归是一类更广泛的回归,包括具有多个解释变量的线性和非线性回归。多元回归是基于独立变量和自变量之间存在线性关系的假设。它还假设自变量之间没有主要的相关性。

线性回归是最简单的机器学习算法之一,属于监督学习技术,用于解决回归问题。在自变量的帮助下,它用于估计连续的因变量。这是通过找到准确预测连续依赖变量结果的最佳拟合线来实现的。

线性回归的应用基于最小二乘估计方法,该方法规定,回归系数的选择方式必须使每个观测响应与其拟合值的平方距离之和最小。由于使用直线将输入变量映射到因变量,线性回归的输出是一个连续值,如年龄、价格、工资等;因此,输出可以是一个无穷大的数。这意味着,输出可以是正的或负的,没有最大或最小界限。

关于线性回归你需要知道什么

- 线性回归的目的是在自变量发生变化的情况下估计连续的因变量。例如,工作时间和工资之间的关系。

- 线性回归假设因变量为正态分布或高斯分布。高斯分布与正态分布相同。

- 线性回归要求误差项正常分布。

- 线性回归的输出必须是连续值,如年龄、价格、重量等。

- 在线性回归中,自变量和自变量之间的关系必须是线性的。

- 线性回归就是在数据中拟合直线。在这方面,通过找到最佳拟合线(拟合直线)来完成,该拟合线也称为回归线,然后用于估计输出。

- 线性回归假设所有预测的因变量值的残差几乎相等。

- 线性回归的beta或系数解释简单明了。

- 线性回归用于解决机器学习中的回归问题。

- 线性回归的应用基于最小二乘估计法,该方法规定,回归系数的选择方式必须使每个观测响应的平方和与其拟合值之和最小化。

- 在样本分析中,线性回归要求每个自变量至少有5个事件。

- 线性回归是一个简单的过程,与逻辑回归相比,计算时间相对较少。

什么是逻辑回归(logistic regression)?

逻辑回归是一种回归分析技术,用于分析一个数据集,其中有一个或多个决定结果的自变量。它是最流行的机器学习算法之一,属于监督学习技术。它既可用于分类,也可用于回归问题。

逻辑回归给出了介于0和1之间的输出,用于解释事件发生的概率。如果输出低于0.5,则表示事件不太可能发生,而如果输出高于0.5,则事件很可能发生。本质上,逻辑回归估计二元结果的概率,而不是预测结果本身。逻辑回归也用于产出与因素之间存在线性关系的情况,在这种情况下,逻辑回归将给出是或否的答案。

logistic回归的应用基于最大似然估计方法,该方法规定,系数的选择必须使Y给出X(似然)的概率最大化。同样重要的是,在逻辑回归中,我们通过激活函数传递输入的加权和,激活函数可以映射0到1之间的值。激活函数通常称为Sigmoidfunction,获得的曲线称为Sigmoid曲线或简单的S曲线。

关于逻辑回归你需要知道什么

- 逻辑回归的目的是使用一组给定的自变量来估计分类依赖变量。例如,逻辑回归可用于计算事件的概率。例如,事件可以是该业务在未来12个月内是否仍将持续经营。

- 逻辑回归假设因变量为二项分布。

- 逻辑回归不要求误差项服从正态分布。

- 逻辑回归的输出值必须是分类值,如0或1、是或否。

- 在logistic回归中,独立变量和自变量之间的关系不一定需要拟合。

- Logistic回归,是对数据拟合一条曲线,在这方面,它使用S形曲线对样本进行分类。正坡度生成S形曲线,负坡度生成Z形曲线。

- 在逻辑回归中,对于预测的依赖变量值的每个水平,残差不一定相等。

- 在逻辑回归中,系数解释依赖于对数、逆对数、二项式等,因此它是多么复杂。

- 逻辑回归用于解决机器学习中的分类问题。

- logistic回归的应用基于最大似然估计方法,该方法规定,系数的选择必须使Y给出X(似然)的概率最大化。

- 在样本分析中,逻辑回归要求每个自变量至少有10个事件。

- 逻辑回归是一个最大似然的迭代过程,和线性回归相比,它需要相对较长的计算时间。

线性回归(linear regression)和表格式逻辑回归(logistic regression in tabular form)的区别

| 比较基础 | 线性回归 | 逻辑回归 |

| 意图 | 线性回归的目的是在自变量发生变化的情况下估计连续因变量。 | Logistic回归的目的是使用一组给定的自变量来估计分类因变量。 |

| 分配 | 它假定因变量为正态分布或高斯分布。 | 它假定因变量为二项分布。 |

| 误差项 | 它要求误差项服从正态分布。 | 它不要求误差项服从正态分布。 |

| 产值 | 线性回归的输出必须是连续值,如年龄、价格、重量等 | 逻辑回归的输出值必须是分类值,如0或1、是或否 |

| 因变量与自变量的关系 | 因变量和自变量之间必须是线性关系。 | 因变量和自变量之间的关系不一定是线性的。 |

| 目标 | 线性回归就是在数据中拟合一条直线。在这方面,通过找到最佳拟合线(拟合直线)来完成,该拟合线也称为回归线,然后用于估计输出。 | Logistic回归,是关于将曲线拟合到数据,在这方面,它使用S形曲线对样本进行分类。 |

| 残差 | 它假设对于所有预测的因变量值,所有残差近似相等。 | 对于每一水平的预测因变量值,残差不一定要相等。 |

| 系数解释 | 线性回归的beta或系数解释简单明了。 | 逻辑回归解释的系数取决于对数、逆对数、二项式等,因此它在某种程度上是复杂的。 |

| 应用 | 它用于解决机器学习中的回归问题。 | 它用于解决机器学习中的分类问题。 |

| 申请依据 | 线性回归的应用是基于最小二乘估计法的 | logistic回归的应用基于最大似然估计方法 |

| 样品分析 | 在样本分析中,每个自变量至少需要5个事件。 | 在样本分析中,每个自变量至少需要10个事件。 |

| 计算时间 | 这是一个简单的过程,与逻辑回归相比,计算时间相对较少。 | 这是一个最大似然的迭代过程,与线性回归相比,它需要相对较长的计算时间。 |

- 发表于 2021-11-30 10:34

- 阅读 ( 189 )

- 分类:教育

你可能感兴趣的文章

进步的(progressive)和回归染色(regressive staining)的区别

...酸酒精中进行鉴别来去除多余的污渍。 什么是回归染色(regressive staining)? 回归染色是一种更快速的染色技术,其中组织被故意过度染色,直到染料浸透所有组织成分。然后组织被选择性地去染色,直到它到达正确的终点。去染...

- 发布于 2020-09-16 11:06

- 阅读 ( 464 )

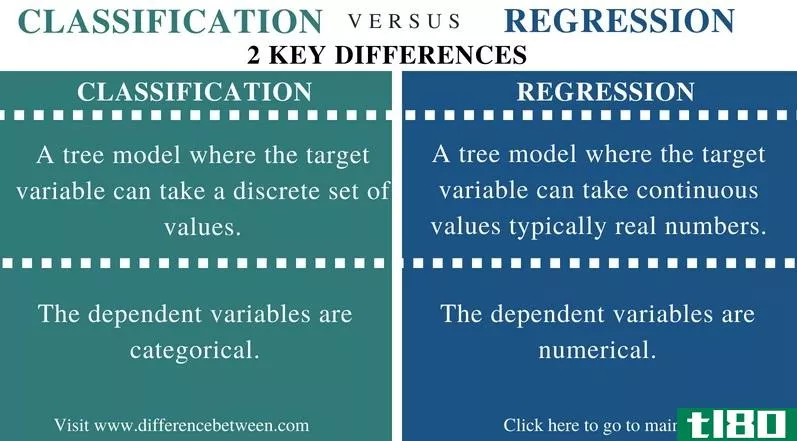

分类(classification)和回归(regression)的区别

...组。它旨在阐明因变量所带来的分类反应。 什么是回归(regression)? 回归是一种基于假定或已知的数值输出值的预测方法。这个输出值是一系列递归分区的结果,每个步骤都有一个数值和另一组因变量,这些变量会分支到另一对...

- 发布于 2020-10-23 10:08

- 阅读 ( 425 )

多元线性回归(mlr)

什么是多元线性回归(mlr)(multiple linear regression (mlr))? 多元线性回归(MLR),也称为多元回归,是一种使用多个解释变量来预测响应变量结果的统计技术。多元线性回归(MLR)的目标是建立解释变量(自变量)和反应变量(因...

- 发布于 2021-06-10 11:43

- 阅读 ( 225 )

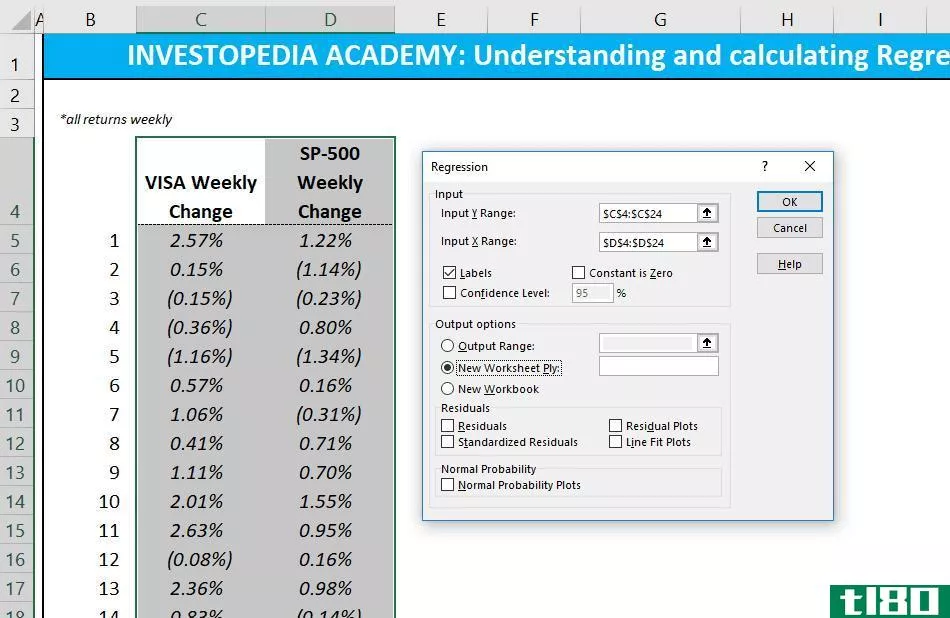

在excel中建立线性回归模型

什么是线性回归(linear regression)? 线性回归是将自变量和因变量之间的线性关系绘制成图形的数据图。它通常用于直观地显示关系的强度和结果的离散度——所有这些都是为了解释因变量的行为。 比如说,我们想测试吃冰淇淋...

- 发布于 2021-06-11 18:26

- 阅读 ( 232 )

方差分析之间的差异(difference betweeen anova)和回归(regression)的区别

方差分析Â vs回归 很难区分方差分析和回归之间的差异。这是因为这两个术语的相似之处多于不同之处。可以说,方差分析和回归是同一枚硬币的两面。 方差分析(ANOVA)和回归统计模型仅适用于有连续结果变量的情况。回归...

- 发布于 2021-06-23 13:54

- 阅读 ( 240 )

相关性之间的差异(differences between correlation)和回归(regression)的区别

...加尔各答 2.相关与回归,可在www.le.ac.uk/bl/gat/virtualfc/stats/regression 3.回归和相关,可在www.abyss.uoregon.edu

- 发布于 2021-06-24 15:38

- 阅读 ( 608 )

相关性(correlation)和回归(regression)的区别

...准偏差: 现在我们可以计算相关系数: 什么是回归(regression)? Regression is a method for finding the relati***hip between two variables. Specifically, we will look at linear regression, which gives an equation for a “line of best fit” for a given sample of data, wher...

- 发布于 2021-06-27 11:05

- 阅读 ( 904 )

神志正常(sanity)和回归测试(regression testing)的区别

...,并确保软件已准备好进行主要测试。 什么是回归测试(regression testing)? 回归测试是检查代码修改并确保它们不会造成任何意外的不利影响的测试类型。例如,考虑具有当前余额和传输模块的银行应用程序。例如,假设开发人...

- 发布于 2021-07-01 23:10

- 阅读 ( 648 )

相关性(correlation)和回归(regression)的区别

...两个短语的理解却心存疑虑。相关性(correlation) vs. 回归(regression)相关性和回归之间的区别在于相关性是两个变量之间关联或缺失的度量,例如,“x”和“y”。“x”和“y”在这里不是自变量或因变量。然而,在回归中,或有变...

- 发布于 2021-07-07 05:26

- 阅读 ( 474 )

相关性(correlation)和回归(regression)的区别

...个清晰的认识。 内容:相关性(content: correlation) vs. 回归(regression) 对比图 定义 关键区别 视频 结论 对比图 Basis for ComparisonCorrelationRegression 意义相关性是一种统计度量,它决定了两个变量之间的相互关系或联系。回归描...

- 发布于 2021-07-09 07:41

- 阅读 ( 415 )